AIOps für KMU: Störungen schneller erkennen und automatisch beheben

Geschätzte Lesezeit: 14 Minuten

Key Takeaways

- AIOps hilft KMU, die Komplexität hybrider IT-Landschaften zu beherrschen und reduziert MTTR deutlich durch KI-gestütztes Monitoring, Event-Korrelation und Auto-Remediation.

- Konkrete Vorteile: schnellere Störungserkennung, reduzierte Ausfallzeiten, geringere Betriebskosten und Entlastung des IT-Personals. Quelle: AIOps für Unternehmen – Systemüberwachung.

- Pragmatischer 30/60/90-Tage-Plan ermöglicht schnelle Erfolge; Pilotprojekte auf Top-3 Services liefern rasch Proof-of-Value.

- Guardrails wie Human-in-Loop, Dry-Run und Rollback sind essentiell für sichere Auto-Remediation. Weiterführende Hinweise: Sicherheitsautomatisierung & Schutzmaßnahmen.

Table of contents

- Warum AIOps für KMU? Nutzen und Dringlichkeit

- Kernkomponenten erklärt

- Wie die Komponenten zusammenarbeiten: Architektur und Ablauf

- Schritt-für-Schritt Implementierungsplan: 30/60/90 Tage

- Konkrete Playbooks & Beispiele

- Metriken & Erfolgsmessung

- Quick Wins für KMU

- Risiken, Fallstricke und Governance

- Tooling & Anbieter-Auswahl

- Praktische Checkliste zum Download

- Mini-Case-Studies

- FAQs

Warum AIOps für KMU? Nutzen und Dringlichkeit

Cloud-Migration, hybride Infrastrukturen und Multi-Cloud-Setups erhöhen die Komplexität. KMU haben häufig kleinen IT-Headcount — jede Stunde Ausfallzeit ist teuer. AIOps kombiniert KI mit Automatisierung, um Probleme schneller zu erkennen und teilweise eigenständig zu beheben. Weitere Erläuterungen finden Sie bei Wie Plattformen für MLOps und AIOps IT-Admins entlasten.

Studien und Branchenberichte zeigen, dass Event-Korrelation Fehlalarme um bis zu 70 % reduzieren und MTTR von Stunden auf Minuten senken kann. Quelle: AIOps für Unternehmen – Systemüberwachung.

Konkrete Vorteile im Überblick:

- Schnellere Störungserkennung: KI-Modelle lernen adaptive Baselines statt starrer Schwellwerte. Quelle: AIOps für Unternehmen – Systemüberwachung.

- Reduzierte Ausfallzeiten: MTTR-Reduktionen von Stunden auf Minuten werden berichtet — ein E-Commerce-Beispiel von 45 Minuten auf 5 Minuten. Quelle: AIOps-Fallbeispiel.

- Geringere Betriebskosten: Studien zeigen Wartungskostenersparnisse bis zu 30 %. Quelle: AIOps-Studie.

- Bessere Priorisierung: Business-kontextuelle Alerts verhindern unnötige Eskalationen.

- Entlastung des IT-Personals: Automatisierung reduziert Routinearbeit. Weiterführende Infos: Mittelstandswiki – AIOps.

Business-Impact am Beispiel:

Ein mittelständisches E‑Commerce-Unternehmen mit 50.000 € Umsatz pro Stunde kann durch MTTR-Reduktion von 2 Stunden auf 15 Minuten pro Incident erhebliche Summen sparen — Beispielrechnung und Annahmen im Abschnitt Case Studies.

Kernkomponenten erklärt

KI-gestütztes Monitoring

Beschreibung: Adaptive Baselines, Anomalieerkennung und kontextuelle Alarme statt starrer Schwellenwerte.

Wie starten: Instrumentiert eure kritischsten 2–3 Services mit Prometheus oder OpenTelemetry und zentralisiert Logs z. B. im ELK-Stack. Siehe: Observability für KMU und AIOps-Referenz.

Event Korrelation

Event Korrelation gruppiert zusammenhängende Alarme und reduziert Alarm-Rauschen — z. B. wenn ein Netzwerkausfall viele abhängige Alarme erzeugt.

Wie Korrelation funktioniert:

- Zeitliche Korrelation: Events innerhalb eines kurzen Zeitfensters zusammenführen.

- Topologische Korrelation: Service-Abhängigkeiten nutzen, um abhängige Fehler zu markieren.

- Ursache-Wirkung durch ML: Modelle lernen historische Kausalitäten.

Praktischer Start: Baut eine Dependency-Map (CMDB oder Script) und implementiert 5–10 grundlegende Korrelationsregeln. Tipps: Alert-Fatigue reduzieren.

Incident Automatisierung

Automatisiert Ticketing, erste Diagnosen, Log-Enrichment und Runbook-Trigger. Beispielaktionen: automatisches Ticketing in ServiceNow/Jira, Log-Extraction, Runbook-Invocation.

Weiterführende Ressourcen: IT-Operations-Automatisierung für KMU und ITSM Chatbots & Automatisierung.

Auto-Remediation

Auto-Remediation führt autonome Problembehebung aus — mit zwingenden Guardrails: Human-in-Loop, Approval-Flows, Dry-Run, Snapshot/Rollback und Audit Logging. Best Practices: Sicherheitsautomatisierung.

Conditional Decision Tree (vereinfacht):

IF Problem erkannt UND Lösung bekannt UND Risiko=niedrig

THEN Autonomous Execution

ELSE IF Problem erkannt UND Lösung bekannt UND Risiko=mittel

THEN Request Approval (Timeout 5 Min)

ELSE

THEN Create Ticket + Escalate to HumanWie die Komponenten zusammenarbeiten: Architektur und Ablauf

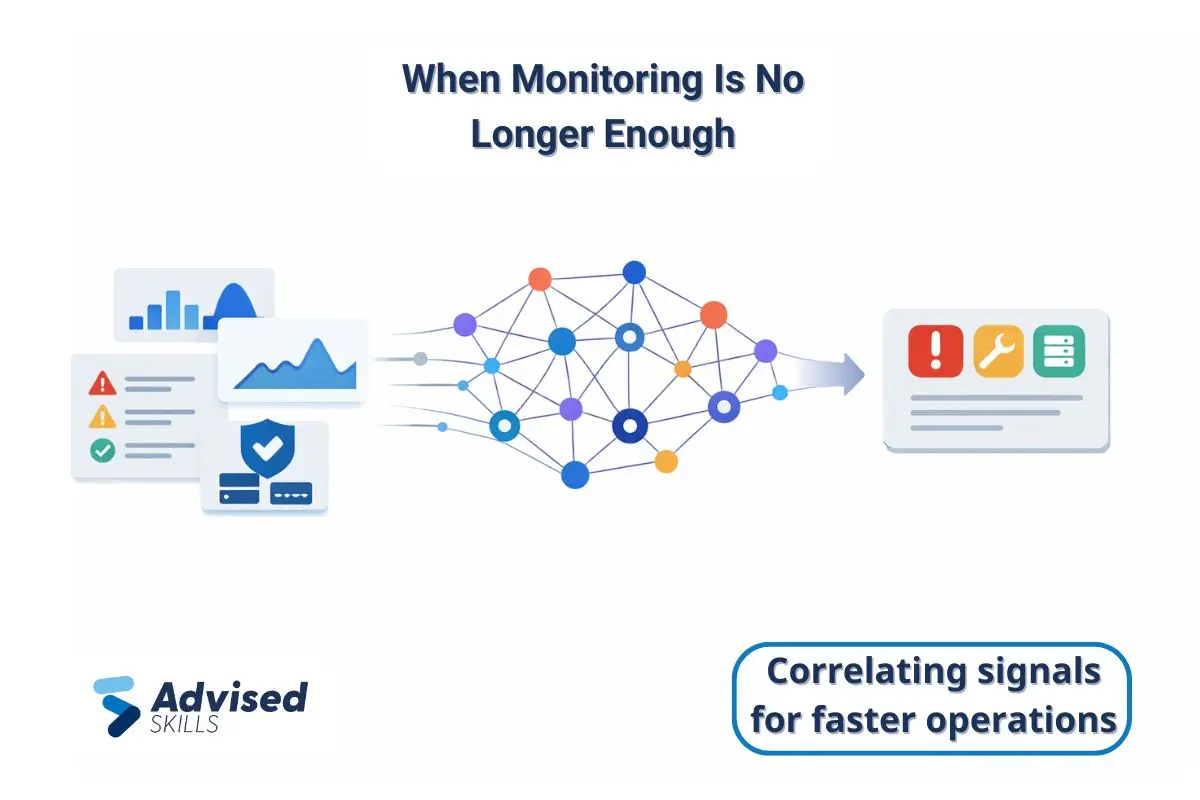

Datenquellen → KI-Monitoring → Korrelation → Automatisierung → Remediation

Schritt für Schritt: Logs, Metrics, Traces und Events werden gesammelt; das Monitoring lernt Baselines; Events werden korreliert; Incidents werden angereichert und in ITSM überführt; Auto-Remediation führt Lösungen aus oder fordert Approval.

[Logs] [Metrics] [Traces] [Events]

↓

[KI-Monitoring]

Baseline Learning

Anomaly Detection

↓

[Event Korrelation]

Zeitlich | Topologisch

↓

[Incident Automatisierung]

Ticketing | Enrichment

↓

[Auto-Remediation]

Autonomous | Approval

↓

[ServiceNow] [Jira] [Observability]Integrationen zu Prometheus, ELK, ServiceNow oder Datadog sind üblich. Quelle: AIOps-Integrationen.

Schritt-für-Schritt Implementierungsplan für KMU: 30/60/90-Tage

Phase 1: Vorbereitung (Woche 0–2)

Ziel: Grundlagen schaffen, Stakeholder alignen, klare Ziele definieren.

- Inventarisiert Top-10 kritische Services; dokumentiert Owner und SLAs.

- Baseline-KPIs messen: aktueller MTTR, MTTD, False-Positive-Rate.

- Cross-funktionales Team bilden und AIOps-Charter erstellen.

Phase 2: Datenbasis schaffen (Woche 2–4)

Ziel: Saubere, standardisierte Datenströme in ein zentrales System bringen.

Empfehlungen: Logs zentralisieren (ELK/Splunk/Cloud-Logging), Metrics mit Prometheus/Datadog sammeln, optional Traces mit OpenTelemetry aktivieren. Siehe: Quelle AIOps.

Phase 3: Pilot KI-Monitoring (Monat 1–2)

Ziel: KI-gestütztes Monitoring auf einem kritischen Service testen und erste Anomalien erkennen.

Baseline-Learning 2–3 Wochen im Silent Mode, danach Alert-Tuning mit Feedback-Loop. Ziel: MTTD < 5 Minuten für kritische Services.

Phase 4: Event Korrelation (Monat 2–3)

Ziel: Alarm-Noise drastisch reduzieren durch intelligente Gruppierung.

Dependency-Map erstellen, initiale Korrelationsregeln implementieren und historische Incidents für ML-Modelle nutzen. Ziel: Alarm-Volumen-Reduktion ≥50%.

Phase 5: Incident Automatisierung & Auto-Remediation (Monat 3–6)

Ziel: Volle Automatisierung für häufige, niedrig-risiko Probleme etablieren.

Top Use Cases priorisieren, Runbooks schreiben, Playbooks implementieren, Guarded Automation einrichten und in Staging testen. Beispiele und Playbooks weiter unten. Tools & Referenzen: OpenText AI Operations Management und AIOps-Quelle.

Phase 6: Rollout & Optimierung (ab Monat 6)

Staged Rollout, monatliches Retraining, Model-Versioning, Governance-Board und KPI-Reviews etablieren.

Konkrete Playbooks & Beispiele

Hier drei einsatzbereite Playbooks (gekürzt dargestellt): Neustart Microservice, Event-Korrelationsregel für Netzausfall, Disk-Cleanup mit Approval.

Playbook A: Neustart eines fehlerhaften Microservice + Log-Analyse + Ticket-Anlage

name: "Auto-Remediate Checkout Service Down"

trigger:

- condition: "service_health == DOWN AND service_name == checkout"

severity: "critical"

steps:

- id: "analyze"

action: "query_logs"

params:

service: "checkout"

timerange: "-30m"

filter: "level:ERROR OR level:FATAL"

- id: "check_restart_count"

action: "query_metric"

params:

metric: "service.restart.count"

labels: { "service": "checkout" }

- id: "approval"

action: "send_approval_request"

params:

channel: "slack"

- id: "restart"

action: "execute_kubectl"

params:

command: "rollout restart deployment/checkout-service -n production"

- id: "verify"

action: "health_check"

- id: "create_ticket"

action: "create_servicenow_ticket"

- id: "notify"

action: "send_slack"Testen in Staging: Simuliert Service-Down, überprüft Rollback und Approval-Mechanik.

Playbook B: Event-Korrelationsregel – Netzausfall → abhängige App-Alarme suppressen

correlation_rule:

name: "Network Segment Outage – Cluster related alerts"

matching_events:

- source: "network_monitor"

event_type: "link_down"

attributes: { "segment": "core-gateway-01" }

correlation_logic:

temporal: "all_events_within_30_seconds"

topological: "events_from_same_network_segment"

action:

create_incident:

title: "Network Segment core-gateway-01 Down – {{ event_count }} related alerts"

suppress_related_alerts: true

suppress_timeout: "until_root_resolved"Playbook C: Auto-Remediation mit Human-in-Loop – Disk-Space

name: "Disk Space Critical – Auto-Remediation with Approval"

trigger:

condition: "disk_usage_percent > 90 AND available_space_gb < 5"

steps:

- id: "analyze_disk_usage"

action: "analyze_filesystem"

- id: "identify_cleanup_candidates"

action: "find_cleanup_targets"

- id: "send_approval_request"

action: "send_approval"

- id: "dry_run_if_requested"

action: "simulate_cleanup"

- id: "execute_cleanup"

action: "cleanup_filesystem"

- id: "verify"

action: "verify_disk_space"Safety-Measures: Backup vor Löschung, Dry-Run-Option, Timeout für Approval, Archiv & Rollback.

Metriken & Erfolgsmessung

Wichtige KPIs für KMU:

- MTTR: Durchschnitt Zeit zur Behebung. Ziel: −50–70%.

- MTTD: Zeit bis Erkennung. Ziel: <5 Minuten für kritische Services.

- Automatisierungsquote: Anteil automatisch gelöster Incidents. Ziel: 30–50% im ersten Jahr.

- False-Positive-Rate: Ziel: <20%.

- Verfügbarkeit (SLA): Ziel: 99,5%+

Monatliches Reporting-Template (gekürzt) hilft, Business-Value zu zeigen und Entscheidungen zu treffen.

Quick Wins für KMU: Rasch umsetzbare Maßnahmen

- Top-3 Services priorisieren: Instrumentierung innerhalb 1–2 Wochen.

- Snapshot-Restarts: Automatische Restart-Policy mit Max-Restart-Guard — Implementierungsdauer: 1 Woche.

- Disk-Cleanup-Playbook mit Approval: Verhindert kritische Disk-Ausfälle — Implementierungsdauer: 1–2 Wochen.

- Basic Event-Korrelation (5–10 Regeln): Reduziert Alerts um 50–70%. Quelle: AIOps-Referenz.

Risiken, Fallstricke und Governance

Technische Risiken & Gegenmaßnahmen:

- Datenqualität: Initialer Daten-Audit, Alerts bei >5% fehlender Daten.

- Modell-Drift: Monatliches Retraining, Model-Versioning und Fallback-Mechanismen.

- Sicherheitsrisiken: Human-in-Loop für sicherheitsrelevante Aktionen, Least-Privilege für Automation-Bots.

- Compliance: Audit-Logs und Retention nach gesetzlichen Vorgaben. Weiterführende Hinweise: Backup-Lösungen für KMU.

Organisatorische Fallstricke: Change Management, realistische Erwartungen, ausreichende Dokumentation und Governance-Board für Playbook-Freigaben.

Tooling & Anbieter-Auswahl für KMU

Auswahlkriterien: TCO, Skalierbarkeit, Integrationen (Prometheus, ELK, OpenTelemetry, ServiceNow, Jira), Usability, Security & Support.

Open-Source vs. Kommerziell:

- Open-Source: Elastic Stack, Prometheus + Alertmanager — flexibel, aber ops-intensiv.

- Kommerziell: Datadog, Dynatrace, New Relic oder Splunk (je nach Budget & Features). Weitere Orientierung: Mittelstandswiki – AIOps.

POC-Dauer empfohlen: 4–6 Wochen; fordern Sie Demos mit eigenen Daten an.

Praktische Checkliste zum Download

════════════════════════════════════════════════════════════════

AIOPS IMPLEMENTIERUNGS-CHECKLIST FÜR KMU

════════════════════════════════════════════════════════════════

PHASE 1: VORBEREITUNG (Woche 0–2)

☐ IT-Systemlandschaft inventarisiert (Top-10)

☐ Baseline-KPIs gemessen

☐ AIOps-Charter erstellt & genehmigt

PHASE 2: DATENBASIS (Woche 2–4)

☐ Log-Aggregation & Metrics-Collection deployed

☐ Naming Conventions & Retention definiert

PHASE 3: PILOT (Monat 1–2)

☐ Baseline-Learning gestartet (Silent Mode)

☐ Alerts & Feedback-Loop etabliert

PHASE 4: KORRELATION (Monat 2–3)

☐ Dependency-Map erstellt

☐ 5–10 Korrelationsregeln deployed

PHASE 5: AUTOMATION (Monat 3–6)

☐ Top-10 Use Cases automatisiert

☐ Playbooks getestet & phased rollout

PHASE 6: ROLLOUT & OPTIMIERUNG (ab Monat 6)

☐ Model-Retraining & Governance etabliert

════════════════════════════════════════════════════════════════Zwei Mini-Case-Studies

Case Study 1: E‑Commerce KMU – Online-Buchungsplattform

Ausgangslage: Checkout/Payment-Probleme mit MTTR 45 Minuten. Maßnahmen: ELK Aggregation, KI-Monitoring, Event-Korrelation und automatisierte Playbooks. Ergebnis nach 4 Monaten: MTTR ≈ 5 Minuten, Auto-Remediation Rate 70%, erhebliche Umsatzvermeidung. Quelle: AIOps-Case.

Case Study 2: Managed Services Provider – Multi-Kunden-Infrastruktur

Ausgangslage: 8.000+ Alerts/Monat, hohe Alert-Fatigue. Maßnahmen: Zentralisierung, Event-Korrelation, Smart Ticketing, Automatisierung einfacher Fixes. Ergebnis nach 6 Monaten: Alerts ↓85% (8.000 → 1.200), Mean Response-Time 1,5h → 12min, Kundenzufriedenheit deutlich besser. Quelle: AIOps-Referenz.

FAQs: Mythen entkräften

Ist AIOps nur für Großkonzerne?

Nein. Moderne Cloud-basierte AIOps-Lösungen sind skalierbar und für KMU bezahlbar. Ein pragmatischer Pilot-Ansatz zeigt schnellen Nutzen. Weiterführend: Mittelstandswiki – AIOps.

Ersetzt Auto-Remediation Menschen?

Nein. Sie nimmt repetitive Aufgaben ab und schafft Freiraum für strategische Arbeit. Human-in-Loop bleibt bei kritischen Aktionen wichtig.

Liefern KI-Modelle sofort perfekte Ergebnisse?

Nein. ML benötigt Trainingsdaten, Tuning und Monitoring. Deshalb sind Dry-Runs, Approval-Flows und iteratives Retraining zentral.

Wie schnell sehe ich erste Erfolge?

Quick Wins (Top-3 Services instrumentieren, einfache Restart-Policies, 5–10 Korrelationsregeln) sind in 4–8 Wochen möglich; volle Automatisierung braucht 6–12 Monate.

Schlussfolgerung & Handlungsaufforderung

AIOps für KMU ist praktikabel, messbar und wirtschaftlich sinnvoll. Startet pragmatisch mit einem Pilot, sichert die Datenqualität und implementiert Guardrails. Für weiterführende Beratung und konkrete Implementierungsempfehlungen können die verlinkten Ressourcen hilfreich sein: AIOps für Unternehmen, OpenText AI Operations Management, Observability für KMU.

Next Steps:

- Checklist herunterladen und Pilot-Service identifizieren.

- Discovery-Call planen und 4‑Wochen-Pilot starten.